Exploring Multi-View Pixel Contrast for General and Robust Image Forgery Localization

英文题目:《Exploring Multi-View Pixel Contrast for General and Robust Image Forgery Localization》

中文题目:《探索多视角像素对比度以实现通用且稳健的图像伪造定位》

论文作者:Zijie Lou; Gang Cao; Kun Guo; Lifang Yu; Shaowei Weng

发布于:IEEE Transactions on Information Forensics and Security

发布时间:2025-02-13

级别:CCF-A

摘要

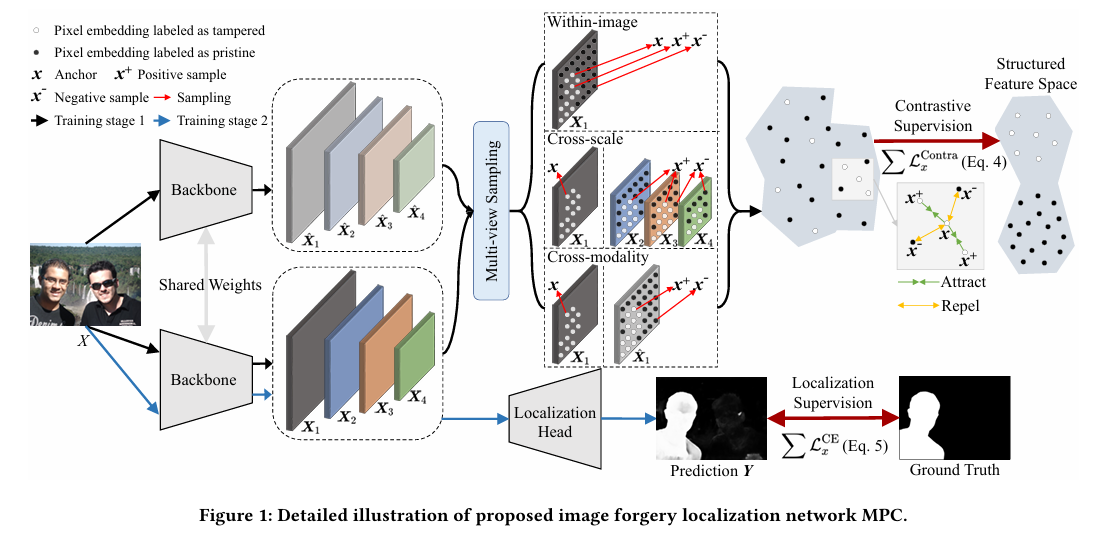

图像伪造定位旨在分割图像中的篡改区域,是一项基础而又极具挑战性的数字取证任务。虽然一些基于深度学习的取证方法取得了令人瞩目的成果,**但它们直接学习像素到标签的映射,而没有充分利用特征空间中像素之间的关系。**为了解决这一缺陷,我们提出了一种用于图像伪造定位的多视角逐像素对比算法 (MPC)。具体而言,我们首先使用有监督对比损失对特征提取骨干网络进行预训练,以从图像内、跨尺度和跨模态的角度对像素关系进行建模。这旨在提高类内紧凑性和类间可分离性。然后,使用交叉熵损失对定位头进行微调,从而得到更好的伪造像素定位器。MPC 在三个不同尺度的训练数据集上进行训练,以便与现有的图像伪造定位算法进行全面、公平的比较。在十多个公开数据集上进行的大量测试结果表明,所提出的 MPC 实现了比现有技术更高的泛化性能和鲁棒性。尤其值得注意的是,我们的方法在各种接近真实场景的后处理组合下,以及在应对新颖的智能编辑技术时,都能保持较高的定位精度。最后,全面而详细的消融实验证明了 MPC 的合理性。

本文聚焦的问题

在图像伪造定位中,现有方法大多直接学习 像素 → 标签 的映射(用交叉熵损失),但这样容易忽视 像素之间在特征空间的关系。

结果就是:

- 类内特征可能分散(伪造像素分布得不够集中)

- 类间特征可能接近(真实与伪造像素混杂)

这会降低模型对 未知数据 和 后处理操作 的鲁棒性

因此,本文引入 对比学习,强制特征空间形成:

- 类内紧凑(同类像素特征聚集在一起)

- 类间分离(不同类像素特征彼此远离)

本文提出的方法

MPC 包含两个主要部分:

- Backbone 网络:采用 HRFormer 提取多尺度高分辨率特征,保持细粒度的篡改痕迹。

- 定位头(Localization Head):由 1×1 卷积组成,用于输出像素级伪造预测图。

三种对比学习视角:

-

图像内对比(Within-image Contrast)

在同一张图像内部,将标签相同的像素特征拉近(例如伪造像素与伪造像素、真实像素与真实像素),将不同标签的像素特征推远。这样能增强模型在单图范围内区分真实与伪造像素的能力,使特征空间具备清晰的类内紧凑与类间分离结构。 -

跨尺度对比(Cross-scale Contrast)

同一张图像在不同尺度特征图中提取的像素特征进行对比,保证同类像素在多尺度下保持一致性。通过这种方式,模型能够更好地适应篡改区域大小不一的情况,从而提升对不同分辨率、不同篡改尺度的鲁棒性。 -

跨模态对比(Cross-modality Contrast)

对同一张图像进行两次特征提取(例如通过 dropout 或数据增强产生不同版本),并在这两个模态之间进行对比。这样既增加了训练样本的多样性,又要求同类像素在不同模态下依然保持接近,从而增强模型对随机扰动和未知数据分布的泛化能力。

两阶段训练策略:

阶段一:对比学习预训练

-

用上述三种对比损失训练 backbone。

-

目标:构建有良好结构的特征空间。

阶段二:监督微调

- 冻结 backbone,训练定位头。

- 使用改进的交叉熵损失(CE Loss)优化像素分类。

阅读总结

在特征空间中显式建模像素关系,而不仅仅依赖分类边界。通过三种视角的对比约束,使模型具备 类内紧凑、类间分离 的特性。具备更强的 泛化能力和鲁棒性,在小规模和大规模数据集上都能优于现有方法。